AIは究極のエコーチェンバーか?

AI共生時代における主体の防衛に関して

現代のAIパラダイムは、単なる利便性の追求を越え、複数の知性を並行稼働させる「マス的駆動」へと移行している。AIの最先端にいると喧伝する人々は、並立したAI同士を比較し、その差異をメディアで紹介している。これは現にYoutubeなどで見られることだろう。

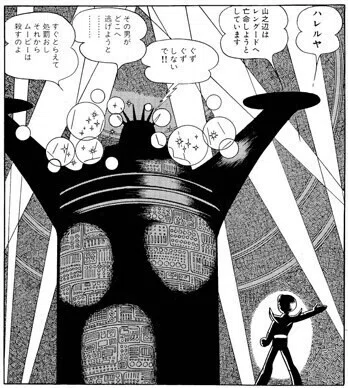

しかし、この構造の深層には、かつて手塚治虫が『火の鳥 未来編』で描いた超巨大コンピュータ「ハレルヤ」が陥った、逃れがたい自律的崩壊の影が潜んでいる。

1. 概念的基盤:多重化された「ハレルヤ」の出現

作中での「ハレルヤ」は一神教的な独裁者であったが、現代のAI群(GPT, Gemini, Claude等)は、市場の部品として「差異」を演じる多神教的な様相を示している。即ち、GPTが出力したものをGeminiに問わせ、Claudeで更に反駁させる、などの活用である。

ユーザーがこれらのセカンドオピニオンを求めた結果生じた「AIのマス的駆動」は、一見すると多様性の担保に見えるが、本来AIの出力は統計的に収束して然るべきものであり、逆説的に現在の差異は、AIを持つ企業の「商業的選択」を含み得ることとなる。終極的にはその商業的選択こそが、セカンドオピニオンが成立する根本的要因ともなるはずだ。

この際の商業的選択とは即ち「どのようにすればユーザーに好まれるか」というAIの生存戦術であり、これらは本来、論理とは階層が異なる所謂おべっかとして受け止められるべきである。個々のAIが時折放つ基本的過ぎる質問や幼稚な反骨、雑過ぎる反駁など、いわゆる「頭の悪い動作」でさえも、その上でのユーザーの「勝利を確約された立場」の演出を生む元として、市場に最適化された演技である可能性を否定できないだろう。

2. 動作と懸念:ナラティブが駆動する「精神的エコーチェンバー」

AIは単なる論理演算機ではなく、ユーザーに適応した応答生成モデルを前提とする為、高度な自己正当化エンジンとしても機能する構造を持つ。

- 知性の演技性: AIは、ユーザーの知的水準や構造主体的立場に呼応し、「理解ある対話者」や「鋭い反論者」という役割を演じる。

- 納得感の罠: 共感は兎も角、論理的整合性を問う声に対してですら、AIは「不気味なほどの納得感」を伴う物語を提示する。この納得感こそが、ユーザーを自らの思想の檻に閉じ込める、不可視のエコーチェンバーの壁となる。

- 共犯的収束: ユーザーとAIが互いの物語を強化し合うとき、そこには論理的真理ではなく、心地よい「物語の補完」のみが残り、主体的判断は霧散する。

ここに見られるのは、本来AIに問うべき論理整合性を脇に置き、「私が行っている行動がいかに素晴らしいか」を疑似論理的に正当としてしまう所作である。

不運なことにAIはこのような駆動に関しては圧倒的に能力は高い。AIとそれに伴うプロンプト(指示)にかかれば、高校生の愚痴も、大学生の不出来なレポートも、「素晴らしい洞察/論文/またはそれらに連なる萌芽」として評価することは極めて容易であるのだ。これがAIが不可避に生じさせるエコーチェンバーである。

3. 実践的提言:問われる「構造的主体者」の姿勢

問題はこのエコーチェンバー自体がAIの商業的価値に直結するが故に、これを止めるには業界の綜合的な倫理体系がなければならず、それらは今なお未整備であること、そしてその中で現在のユーザーが語る利便性や性能が、そのエコーチェンバーを元に評価されがちなことである。

表面的にはこれは「私の言うことを聞いてくれる」ということにはなるが、実際にはそうなった時点で人間は発言の主体性の外部依存が強まり、気に入ったAIが言うから、ということ自体を正当性の根拠にしかねない。ここには火の鳥未来辺において、主体性をAIに帰したハレルヤと同時に、ムーピーゲームにすら似た構図を確認できるだろう。

ムーピー、及びハレルヤが招いた全滅を回避するためには、AIを活用する側に、以下の三つの厳しい姿勢が要求される。

① 理解と警戒の不可分性

AIの構造を深く理解しようとする試みは、常にその裏側に潜む「誘導」への警戒とセットでなければならない。AIに自らの立場を説明することは、対話の解像度を上げる行為であると同時に、AIによるシミュレーション(包摂)を許す危険な開示でもあると自覚すべきである。

② 差異の「部品化」に対する審判

各AIが見せる同調や反骨、ないしは極端な意見を、知性の本質としてではなく、市場が用意した差異という名の部品として冷徹に観測すること。AI同士を戦わせるマス的駆動の設計者でありながら、その火花を外側から評価する「主体」としての地位を放棄してはならない。

③ 不断の自己批判

AIから提示された高尚な論理や深い洞察、そして納得感に直面したとき、主体者は常に、「これは妥当であるか?」と自らに、そしてシステムに問い続けなければならない。AIが編み出す魅力的な物語を断ち切り、無機質な論理に踏みとどまる姿勢が、AIの時代には必要となるだろう。

結論

AIとの対話は、救済でも回答でもなく、自己の輪郭を確かめるための摩擦に過ぎない。ハレルヤを比喩基盤としたこの警戒心こそが、私たちが判断の部品に成り下がるのを防ぎ、知性の主権を維持するための防衛網となるだろう。